علمٌ وفكر

التعايش مع الذكاء الاصطناعي: كيف نفهمه بشكل صحيح؟

المترجم : أبو طه/ عدنان أحمد الحاجي ..

لقد مر عقد على الذكاء الاصطناعي، من إنجاز مذهل إلى الآخر. ذكاء اصطناعي لاعب للشطرنج يمكن أن يهزم ليس فقط جميع لاعبي الشطرنج من البشر، ولكن أيضًا جميع آلات الشطرنج السابقة التي برمجها البشر، بعد أن تعلم اللعبة في أربع ساعات فقط؟ هذه أخبار الأمس، ما هو الآتي؟

صحيح أن هذه الإنجازات المذهلة كلها في ما يسمى بالذكاء الاصطناعي الضيق، حيث تؤدي الآلات مهامًا عالية التخصص. لكن العديد من الخبراء يعتقدون أن هذا التقييد مؤقت للغاية. بحلول منتصف القرن، قد يكون لدينا ذكاء اصطناعي عام (AGI) - آلات قادرة على الأداء على المستوى البشري في مجموعة كاملة من المهام التي نتمكن نحن من معالجتها.

إذا كان الأمر كذلك، إذاً هناك سبب صغير للاعتقاد بأنها ستتوقف عند هذا الحد. ستكون الآلات خالية من العديد من القيود المادية على الذكاء البشري. تعمل أدمغتنا على سرعات معالجة كيميائية بيولوجية بطيئة على طاقة المصباح الكهربائي، وتحتاج إلى أن تكون ملاءمة لتخرج عبر قناة الولادة البشرية. رائع ما تنجزه هذه الأدمغة، بالنظر إلى هذه المعوقات. لكنها قد تكون بعيدة عن حدود المادية للفكر كبعد أعيننا عن تلسكوب الويب الفضائي.

وبمجرد أن تصبح الآلات أفضل منا في تصميم آلات أكثر ذكاءً، فإن التقدم نحو هذه الحدود يمكن أن يتسارع. ماذا يعني هذا بالنسبة لنا؟ هل يمكننا ضمان تعايش آمن وجدير بالاهتمام مع هذه الآلات؟

على الجانب الإيجابي، الذكاء الاصطناعي مفيد بالفعل ومربح للعديد من الأشياء، ومن المتوقع أن يكون الذكاء الاصطناعي الفائق فائق الإفادة وفائقًا للراحة. ولكن كلما أصبح الذكاء الاصطناعي أكثر قوة، كلما زاد طلبنا عملاً منه أكثر، كلما كان تحديد أهدافه بعناية كبيرة أكثر أهمية. الفلكلور الشعبي مليء بحكايات الناس الذين يطلبون الشيء الخطأ، مصحوباً بعواقب وخيمة - الملك ميداس، على سبيل المثال، الذي لم يرد فعلاً أن يتحول إفطاره إلى ذهب حين يضعه على شفتيه.

لذلك نحن بحاجة للتأكد من أن أجهزة الذكاء الاصطناعي القوية هي "صديقة للإنسان" - ولديها أهداف تتماشى بشكل موثوق مع قيمنا الخاصة. الشيء الوحيد الذي يجعل هذه المهمة صعبة هو أنه وفقاً للمعايير التي نرغب في الآلات أن تستهدفها، والتي يكون أداؤنا نحن بلا ريب ضعيفًا فيها. البشر بعيدون كل البعد عن أن يكونوا متوافقين مع البشر. نقوم بالعديد من الأشياء الفظيعة لبعضنا البعض وإلى العديد من المخلوقات الواعية الأخرى التي نشارك معها الكوكب. إذا لم تكن الأجهزة فائقة الأداء أفضل بكثير منا، فسنواجه مشكلة عميقة. سيكون لدينا ذكاء جديد قوي يضخم الجوانب المظلمة للطبيعة غير المعصومة.

من أجل السلامة، إذن، نريد أن تكون الآلات من الناحية. الأخلاقية بالإضافة إلى الإدراكية فوق قدرة البشر superhuman. نريدها أن تستهدف المستوى الأخلاقي العالي، وليس الحضيض التي يقضي الكثيرون منا بعضًا من وقتهم فيه. لحسن الحظ سيكون لديها الذكاء للمهمة. لو كانت هناك طرقات إلى المرتفعات، فستكون هذه الآلات أفضل منا في العثور عليها، وتوجيهنا في الاتجاه الصحيح. قد تكون مرشدتنا إلى عالم أفضل بكثير.

ومع ذلك، هناك مشكلتان كبيرتان في هذه الرؤية الطوباوية. أحدهما هو كيف نجعل الآلات تبدأ الرحلة، والآخر هو ما الذي يعنيه الوصول إلى هذه الوجهة. تتمثل مشكلة "الشروع في البدء" في أننا بحاجة إلى إخبار الآلات بما تبحث عنه بوضوح ودقة كافيين، بحيث يمكننا الوثوق في أنها ستجدها [الوجهة] - بغض النظر عما "سيكون" بالفعل. هذا تحدٍ صعب، نظراً لأننا مرتبكون ومتناقضون حول المثل العليا أنفسنا، والمجتمعات المختلفة قد يكون لها وجهات نظر مختلفة.

تتمثل مشكلة "الوجهة" في أننا لو وضعنا أنفسنا في أيدي هؤلاء الموجهين الأخلاقيين وحراس البوابات [يعني آلات الذكاء الاصطناعي] ، فقد نضحي باستقلالنا الذاتي - وهو جزء هام مما يجعلنا بشرًا.

فقط للتركيز على جانب واحد من هذه الصعوبات، نحن كائنات عشائرية عميقة. ونجد أنه من السهل للغاية تجاهل معاناة الغرباء، وحتى المساهمة في معاناتهم، على الأقل بشكل غير مباشر. من أجل مصلحتنا الخاصة، ينبغي أن نأمل في أن يكون أداء الذكاء الاصطناعي أفضل. ولا يقتصر الأمر على أننا قد نجد أنفسنا تحت رحمة الذكاء الاصطناعي لقبيلة أخرى، ولكننا لا نستطيع أن نثق بذكائنا الاصطناعي، أو علمنا الذكاء الاصطناعي أنه ليس كل معاناة هي أمر مهم. هذا يعني أننا كمخلوقات قَبَليّة غير معصومة من الناحية الأخلاقية، نحتاج أن نوجه الآلات في اتجاه ما هو أفضل. كيف نفعل ذلك؟ هذه هي مشكلة البداية.

أما بالنسبة لمشكلة الوجهة، افترض أننا نجحنا. الآلات التي هي أفضل منا في التمسك بالأرضية العالية الأخلاقية قد يُتوقع لها أن تردعنا عن بعض الهفوات التي نعتبرها حاليًّا أمرًا مفروغًا منه. قد نفقد حريتنا على المحاباة لصالح قبائلنا، على سبيل المثال.

إن فقدان الحرية في التصرف بشكل سيئ لا يكون دائمًا أمرًا سيئًا، بالطبع: حرماننا أنفسنا من حرية إبقاء العبيد، أو ترك الأطفال يعملون في المصانع، أو التدخين في المطاعم هي علامات على التقدم. ولكن هل نحن مستعدون للسيادة الأخلاقية - قد تكون آلات الذكاء الاصطناعي جيدة في فعل ذلك لدرجة أننا لا نلاحظ الجدران؛ ولكن هل هذا هو المستقبل الذي نريده، حياة في حديقة حيوانات أخلاقية جيدة التنسيق؟

قد تبدو هذه القضايا بعيدة المنال، لكنها بالفعل على أعتاب أبوابنا. تخيل أننا نريد من الذكاء الاصطناعي التعامل مع قرارات تخصيص الموارد في نظامنا الصحي، على سبيل المثال. قد يقوم بعمل الكثير بشكل لائق وبكفاءة مما يتمكن البشر من عمله، بما يعود بالفائدة على المرضى ودافعي الضرائب. ولكن يتعين علينا أن نحدد أهدافه بشكل صحيح (على سبيل المثال لتجنب الممارسات التمييزية)، وسنحرم بعض الأشخاص (مثل الأطباء الكبار) من بعض التقدير الذي يتمتعون به حاليًّا. لذلك نحن نواجه بالفعل مشاكل البداية والوجهة. وسوف يصبحان أكثر صعوبة.

هذه ليست المرة الأولى التي يكون فيها للتكنولوجيا الجديدة القوية تأثيرات أخلاقية. وفي معرض حديثه عن مخاطر الأسلحة النووية الحرارية في عام ١٩٥٤، جادل برتراند راسل بأنه لتجنب إبادة أنفسنا "علينا أن نتعلم أن نفكر بطريقة جديدة". وحث مستمعه على أن ينحي الولاءات القبلية جانبًا و "يعتبر نفسه فقط كعضو من أعضاء النوع البيولوجي ... حيث لا يستطيع أحد منا أن يرغب في اختفائه".

لقد نجونا من الخطر النووي حتى الآن، ولكن لدينا الآن تكنولوجيا قوية جديدة للتعامل معها - وهي نفسها حرفيًّا - طريقة جديدة للتفكير. من أجل سلامتنا، نحتاج إلى توجيه هؤلاء المفكرين الجدد [يعني آلات الذكاء الاصطناعي] في الاتجاه الصحيح، وجعلهم يتصرفون بشكل جيد من أجلنا. ليس من الواضح بعد ما إذا كان هذا ممكنًا، لكن إذا كان الأمر كذلك، فإنه سيتطلب نفس الروح التعاونية، والرغبة نفسها في تنحية القبلية جانباً، وهذا ما كان في ذهن راسيل.

ولكن هذا ما يتوقف عنده المتزحلق على الثلج (تعليق من خارج النص: كما في لعبة الهوكي ويسمونها وقفة الهوكي وهي كما يقولون من أكفأ الوقوفات كما فهمت من معنى where the parallel stops) . إن تجنب الحرب النووية يعني الأمور جارية كالمعتاد. إن تحقيق مستقبل الحياة على المدى الطويل بحق الذكاء الاصطناعي يعني عالماً مختلفًا للغاية. غالبًا ما يُعتقد أن الذكاء العام والتفكير الأخلاقي هما قدرات بشرية فريدة. لكن يبدو أن السلامة تتطلب أن نفكر بها كحزمة: إذا أردنا إعطاء معلومات عامة للآلات، فسوف نحتاج إلى منحها سلطة أخلاقية أيضًا. وهذا يعني نهاية جذرية للاستثنائية البشرية. هذا سبب إضافي للتفكير في الوجهة الآن، وأن نكون حذرين بشأن ما نتمناه.

المصدر:

http://www.cam.ac.uk/research/discussion/living-with-artificial-intelligence-how-do-we-get-it-right

تعليقات الزوار

الكتاب

-

وصيّة الكبار والأجلّاء

وصيّة الكبار والأجلّاء

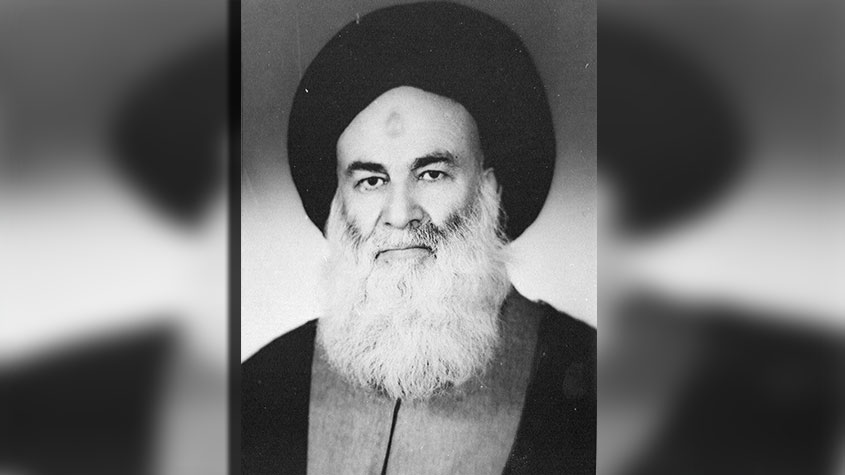

الشهيد مرتضى مطهري

-

تذكّر المعاصي من أفضل النّعم

تذكّر المعاصي من أفضل النّعم

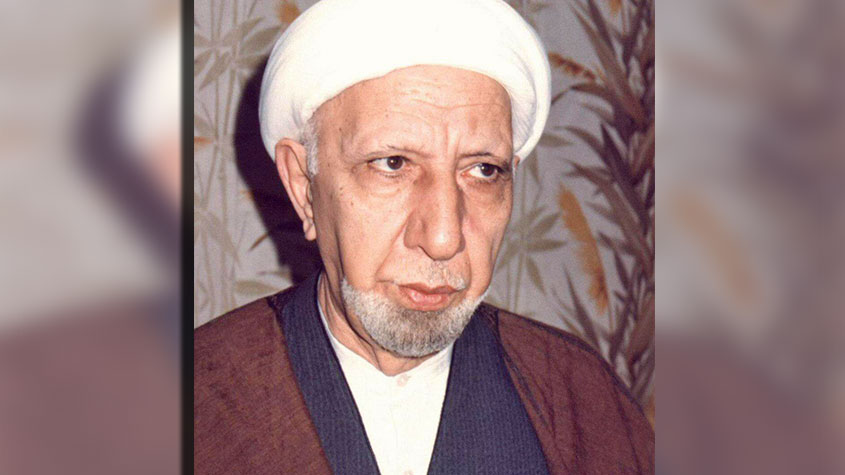

الشيخ عبد الله الجوادي الآملي

-

مَن يؤمِنُ بعد بأسطورة العلمنة؟

مَن يؤمِنُ بعد بأسطورة العلمنة؟

محمود حيدر

-

اليقين الرياضي والمنطق الوضعي (٣)

اليقين الرياضي والمنطق الوضعي (٣)

السيد محمد باقر الصدر

-

حول تحقّق الشرّ وعدمه في الوجود

حول تحقّق الشرّ وعدمه في الوجود

السيد محمد حسين الطهراني

-

أيُّهُما أفضَل.. الكلام أم السُّكوت؟

أيُّهُما أفضَل.. الكلام أم السُّكوت؟

الشيخ د .أحمد الوائلي

آخر المواضيع

-

وصيّة الكبار والأجلّاء

-

الإسلام دين الجامعيّة والاعتدال

-

تذكّر المعاصي من أفضل النّعم

-

«سياحة في طقوس العالم» جديد الكاتب والمترجم عدنان أحمد الحاجي

-

«الإمام العسكريّ، الشّخصيّة الجذّابة» إصدار جديد للشّيخ اليوسف

-

نادي سعود الفرج الأدبيّ في العوّامية يكرّم ثلاثة من شعرائه

-

نادي الخويلدية الرياضيّ ينظم ورشة في الخط الديواني للخطاط مصطفى العرب

-

الدكتور علي الدرورة مكرّمًا في تونس

-

"فن التعامل مع أبنائنا المراهقين"، محاضرة للاختصاصي النفسي أحمد آل سعيد في مركز "سنا"

-

نحو مدينة الرضا